AI 智慧監視系統製作專案報告

姓名:1121410025林浩民

姓名:1121410033 賴昱宏

姓名:1121410030張喆勛

基於 Raspberry Pi 與 MediaPipe

/ YOLO 之開發實作

系統環境圖 WebCam測試 YOLO測試

手部偵測

臉部網格

(1) AI 監視系統製作概述

本專案旨在利用開源 AI 框架與嵌入式系統,建立一套具備即時影像辨識能力的監控平台。透過整合網頁串流技術與機器學習模型,實現人臉、手部及物件的自動偵測與分類。

(2) 資訊專案結構說明

專案採用模組化設計,主要包含以下部分:

- 前端介面: HTML5 / CSS3 /

JavaScript (用於即時影像呈現)。

- 影像處理: OpenCV,

MediaPipe, YOLOv8。

- 通訊協定: HTTP / Flask Web 框架 (實作影像串流伺服器)。

- 硬體端: Raspberry Pi / Web

Camera。

(3) 資訊系統環境圖 (UML) 與邏輯

系統環境架構

透過 SSH 遠端連線至 Raspberry Pi,並利用 Python 環境執行核心辨識邏輯。使用者可經由同一網域下的 PC 瀏覽器查看辨識結果。

程式核心邏輯

1. 初始化 Camera 並載入 AI 模型 (MediaPipe/YOLO)

2. 進入 While 迴圈:讀取影像影格 (Frame)

3. 將影格轉換為 RGB 並送入模型進行 Inference (推理)

4. 在影格上繪製標記 (Landmarks / Bounding Box)

5. 透過 Flask Response 將影格串流至網頁端

(4) 功能測試一 : Web Camera

測試硬體連線是否正常,並透過指令確認 Linux 下的裝置掛載情況。

$ ls /dev/video*

$ fswebcam test.jpg

實測結果:相機能正常開啟並擷取解析度為 352x288 之靜態影像。

(5) 功能測試二 : YOLO 物件偵測

利用 YOLO 模型進行環境中的物件類別辨識,包含人、辦公設備等標籤分類。

測試通過 (Success)

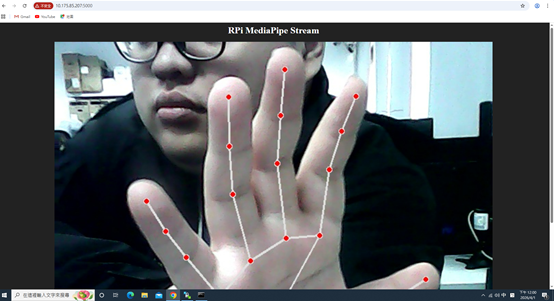

(6) 功能測試三 : 手部偵測 (MediaPipe)

實作 MediaPipe Hands 模型,精準定位手部 21 個關鍵點位。

RPi MediaPipe

Stream

即時捕捉五指關節,可用於手勢控制或行為分析。

即時辨識中

(7) 功能測試四 : 臉部網格偵測 (Face Mesh)

實作 468 點 3D 臉部網格偵測,能捕捉細微的面部表情變化。

Face Mesh 網頁監控系統

透過 Flask 網頁介面即時呈現臉部 3D 拓撲結構。

© 2026 AI 專案開發小組 - 基於 Raspberry Pi 與 OpenCV 實作

© 2026 AI 專案開發小組 - 基於 Raspberry Pi 與 OpenCV 實作